北京津發(fā)科技股份有限公司是科技部認(rèn)定的科技型中小企業(yè),具有自主研發(fā)與創(chuàng)新能力,具備自主進(jìn)出口經(jīng)營權(quán);自主研發(fā)技術(shù)、產(chǎn)品與服務(wù)榮獲多項(xiàng)省部級(jí)科學(xué)技術(shù)獎(jiǎng)勵(lì)、國家軟件著作權(quán)和省部級(jí)新技術(shù)新產(chǎn)品(服務(wù))認(rèn)證;通過了歐洲CE、美國FCC、歐盟RoHS、ISO9001、ISO14001、OHSAS18001等多項(xiàng)認(rèn)證和防爆產(chǎn)品認(rèn)證。

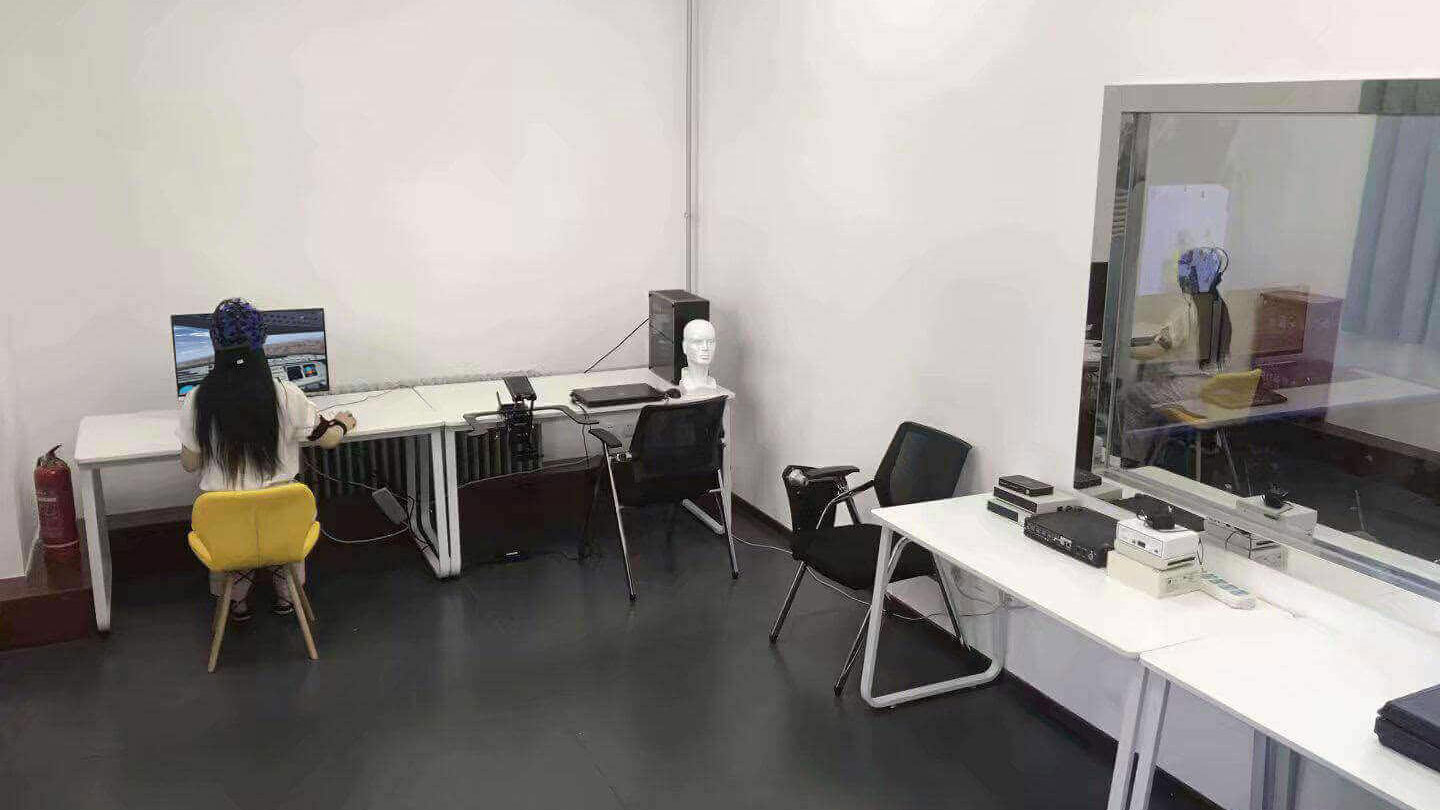

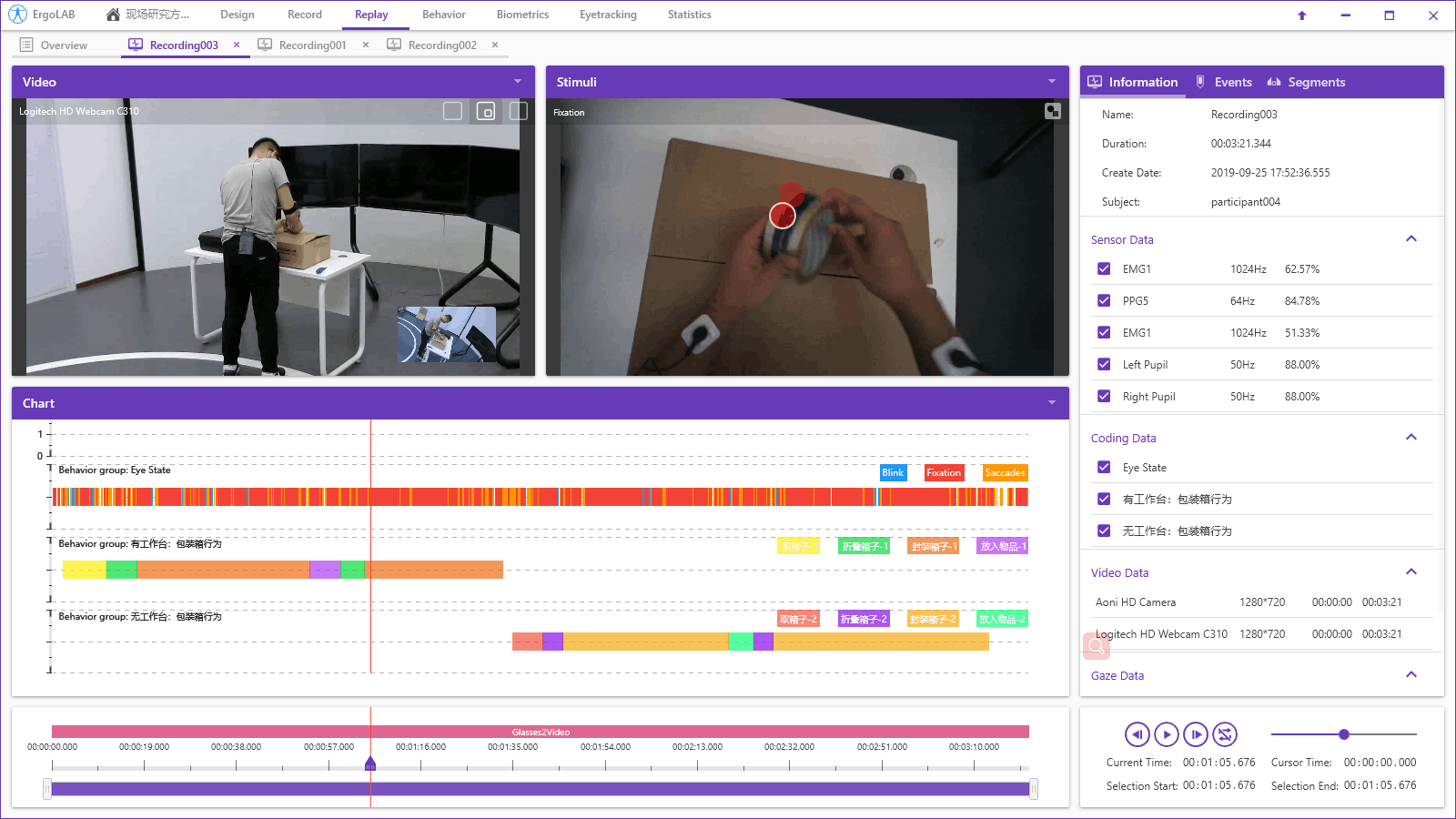

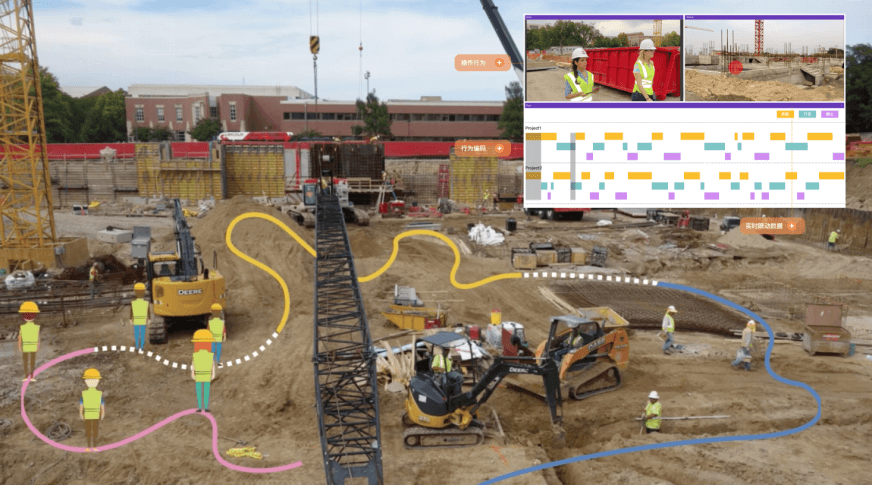

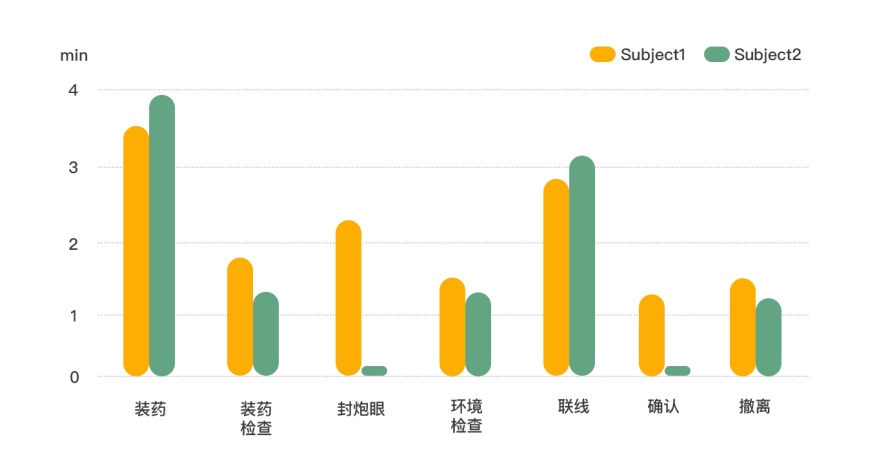

津發(fā)科技致力于實(shí)驗(yàn)室建設(shè)的專業(yè)化與特色化,提供實(shí)驗(yàn)室、實(shí)驗(yàn)實(shí)訓(xùn)及科研基地建設(shè)的全過程服務(wù)與建設(shè)方案。產(chǎn)品技術(shù)涵蓋:認(rèn)知神經(jīng)科學(xué)技術(shù)、人機(jī)交互技術(shù)、可穿戴技術(shù)、人工智能技術(shù)、腦機(jī)接口技術(shù)、眼動(dòng)追蹤技術(shù)、虛擬現(xiàn)實(shí)技術(shù)、面部表情分析及狀態(tài)識(shí)別技術(shù)、時(shí)空軌跡分析技術(shù)等;自主研發(fā)的人-機(jī)-環(huán)境同步云平臺(tái)可實(shí)時(shí)同步采集多通道人機(jī)環(huán)境測(cè)試數(shù)據(jù),結(jié)合大數(shù)據(jù)平臺(tái)建立多模態(tài)大數(shù)據(jù)庫,并采用人工智能技術(shù)相關(guān)算法實(shí)現(xiàn)有效的監(jiān)測(cè)、識(shí)別、預(yù)測(cè)、分析和評(píng)價(jià)模型等。

多年來在軍工國防領(lǐng)域,以及教育科研領(lǐng)域積極推動(dòng)人因與工效學(xué)技術(shù)進(jìn)步,攜手眾多科研工作者進(jìn)行聯(lián)合開發(fā)與科研實(shí)驗(yàn)、人才培養(yǎng)、學(xué)術(shù)合作與產(chǎn)學(xué)研融合,聯(lián)合申報(bào)基金項(xiàng)目、科技項(xiàng)目等;承接和參與多項(xiàng)國家自然科學(xué)基金、國家重點(diǎn)研發(fā)計(jì)劃、科技項(xiàng)目和標(biāo)準(zhǔn)編制;承接科研院所和高校實(shí)驗(yàn)室規(guī)劃建設(shè)、并通過產(chǎn)學(xué)研方式與學(xué)術(shù)和科研機(jī)構(gòu)建立合作關(guān)系,聯(lián)合國家科研課題進(jìn)行科技攻關(guān),并聯(lián)合開發(fā)適合中國國情的基于人工智能和虛擬現(xiàn)實(shí)技術(shù)的人-機(jī)-環(huán)境測(cè)試與工效學(xué)評(píng)價(jià)等多項(xiàng)科研成果,致力于將人因與工效學(xué)科學(xué)方法和成果應(yīng)用到國防和社會(huì)科技發(fā)展進(jìn)步。

津發(fā)科技重視客戶服務(wù)質(zhì)量、為客戶創(chuàng)造價(jià)值,致力于推動(dòng)人因工程與工效學(xué)行業(yè)發(fā)展和青年人才培養(yǎng),2012年起在國內(nèi)*發(fā)起“科研支持計(jì)劃”,無償支持人因工程領(lǐng)域青年學(xué)者進(jìn)行科學(xué)研究;2014年工業(yè)和信息化部CSIP 與津發(fā)科技聯(lián)合共建“工信部CSIP-津發(fā)人因工程技術(shù)創(chuàng)新中心”,持續(xù)進(jìn)行技術(shù)研發(fā)和基礎(chǔ)及應(yīng)用創(chuàng)新研究; 2016年起聯(lián)合中國人類工效學(xué)學(xué)會(huì)發(fā)起“工效學(xué)卓-越研究工程”并設(shè)立“CES-Kingfar基金(工效學(xué)會(huì)-津發(fā)優(yōu)秀青年學(xué)者聯(lián)合研究基金CES‐Kingfar Excellent Young Scholar Joint Research Funding)”,借鑒國家自然科學(xué)基金的評(píng)審標(biāo)準(zhǔn),對(duì)特別優(yōu)秀的青年學(xué)者研究計(jì)劃書予以資助;2017年起聯(lián)合教育部高等教育司設(shè)立“人因與工效學(xué)”產(chǎn)學(xué)合作協(xié)同育人項(xiàng)目,并由高教司發(fā)布申報(bào)指南和立項(xiàng)名單;2019年起與工效學(xué)聯(lián)合會(huì)(IEA)設(shè)立獎(jiǎng)項(xiàng)The IEA/Kingfar HFE Research Award“人因與工效學(xué)卓-越研究獎(jiǎng)”,旨在表彰世界各地為解決發(fā)展中國家典型人因工程問題而取得高質(zhì)量人因工程與工效學(xué)研究成果的個(gè)人,以期改善發(fā)展中國家人民的福祉;2019年中國人類工效學(xué)學(xué)會(huì)聯(lián)合北京津發(fā)科技股份有限公司正式啟動(dòng)中國首屆HFE Award全國人因與工效學(xué)創(chuàng)新大賽。

津發(fā)科技將持續(xù)以推動(dòng)人因工程發(fā)展為己任,在國防和教育科研各領(lǐng)域推動(dòng)人因與工效學(xué)技術(shù)進(jìn)步,為中國教育科研事業(yè)的發(fā)展提供服務(wù)。